La semana pasada, la revista TIME publicó otro interesante artículo sobre la Singularidad de Kurzweil.

Kurzweil define la Singularidad como ese momento en el que una máquina pueda ser lo suficientemente rápida o poderosa como para emular la conciencia.

Desde ese momento en adelante, no hay razón para pensar que las computadoras dejarán de ser más poderosas. Seguirán desarrollándose hasta que sean mucho más inteligentes que nosotros. Su rata de desarrollo también se incrementará, porque tomarán el mando de su propio desarrollo.

Siguiendo el rastro de la ley de Moore (la cantidad de transitores que pueden ser colocados económicamente en un circuito impreso, se duplica cada 18 meses), Kurzweil predice que la ingeniería reversa del cerebro humano ocurrirá durante los años 20s y que la Singularidad llegará alrededor del 2045.

Muchas personas descartan este escenario como una utopía futurista. Pero en realidad, la ley de Moore demuestra una evolución exponencial en el progreso de la capacidad de cómputo y, así como sucede con el teorema de Borel (ese de los infinitos monos que escriben las obras completas de Shakespeare), nos enfrenta a una barrera cognitiva:

Las curvas exponenciales comienzan lentamente, luego se disparan hacia el infinito. De acuerdo a Kurzweil, no hemos evolucionado para pensar en términos de crecimiento exponencial. «No es intuitivo, nuestros vaticinadores son lineales. Cuando tratamos de evadir a un animal, trazamos la proyección lineal de dónde estará en 20 segundos y qué haremos al respecto. Eso está cableado en nuestros cerebros»

Nos cuesta entender el avance más allá de lo evidente. Desde el automóvil hasta la PC, el siglo XX está lleno de tecnologías imposibles. Por esa misma razón, en las películas los alienígenas hablan inglés (o, mejor dicho, usan esa forma primitiva y defectuosa de comunicación que nosotros llamamos hablar), o usan sus extremidades para pilotar sus naves.

A pesar de esos «errores», pienso que desde Frankenstein, hasta Neuromancer, la literatura y el cine de ciencia ficción nos han adelantado escenarios probables –fábulas– que nos han permitido construir una ética y una moral para inventos que todavía no hemos desarrollado. Piénsalo bien: una fábula, una lección de vida antes de que el hecho sea posible. No deja de maravillarme que la ficción sea nuestra forma más depurada de lidiar con el futuro.

Para mi generación es imposible leer sobre máquinas fabricando máquinas sin pensar en Terminator. «No construirás Skynet» podría ser un mandamiento para el siglo XXI, y es el tipo de escenarios que estudia el Instituto para la Singularidad.

Kurzweil admite que hay un nivel de riesgo fundamental asociado con la Singularidad que es imposible de refinar, simplemente porque no sabemos lo que una altamente avanzada inteligencia artificial, encontrándose como una recién creada habitante del planeta Tierra, podría elegir hacer.

(…)

No tienes que ser un cybor super-inteligente para entender que introducir a una forma de vida superior en tu propia biosfera es un básico error Darwiniano.

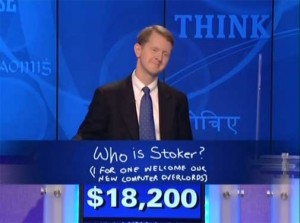

También mientras leía este artículo, Watson, un software (¿o una inteligencia?) creada por IBM, le ganaba a dos campeones de Jeopardy! el popular programa de preguntas y respuesta de la televisión norteamericana.

Después de presenciar como Watson interpreta una respuesta y –gracias a ciertas asociaciones lógicas– la convierte en una pregunta en lenguaje natural, casi a la misma velocidad que sus contrapartes humanos, no es muy loco pensar que en veinte años algún sucesor de Watson superará consistentemente la prueba de Turing. Hay algo de cierto en esa broma final que hace Ken Jennings, uno de los adversarios de Watson, en la que toma una referencia de los Simpsons para darle la bienvenida a nuestros nuevos amos computarizados.

La otra posibilidad difícil de digerir es que la Singularidad también represente nuestro atajo para alcanzar la inmortalidad:

En el futuro de Kurzweil, la biotecnología y la nanotecnología nos dan el poder de manipular nuestros cuerpos y el mundo que nos rodea a nuestra voluntad, a nivel molecular. El progreso se hiperacelera, y cada hora trae un siglo de avances científicos. Desechamos a Darwin y nos hacemos cargo de nuestra propia evolución. El genoma humano se transforma en código para ser probado y optimizado y, si es necesario, reescrito. La extensión de vida indefinida se vuelve una realidad; la gente muere sólo si lo decide. La muerte pierde su gancho definitivamente.

Y una vez que la humanidad avance (¿o retroceda?) hasta ese punto, definitivamente necesitaremos repensar todo nuestro papel en el universo.

Sigue leyendo Singularity: Kurzweil on 2045, When Humans, Machines Merge – TIME.